3ra Evaluación II Término 2017-2018. Febrero 20, 2018

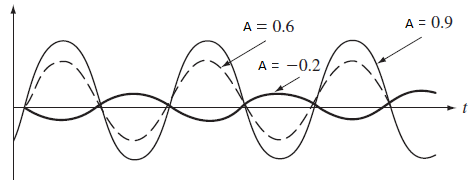

Tema 3 (25 puntos) Considere la combinación lineal de dos sinusoides.

X(t) = A_1 \cos (\omega _0 t + \theta _1) + A_2 \cos (\sqrt{2}\omega_0 t + \theta _2)Donde θ1 y θ2 son variables aleatorias independientes y uniformes en el intervalo (0, 2π).

A1, A2 son variables aleatorias conjuntas Gaussianas.

Asuma que las amplitudes son independientes de las variables aleatorias de la fase.

a) Encuentre la media para X(t)

b) Encuentre la función de auto-correlación para X(t)

Rúbrica: literal a (5 puntos), literal b (20 puntos)