Referencia: León-García 445 Important Continuous Random Variables p164

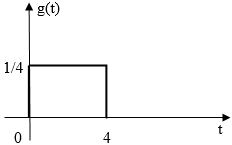

Uniforme

S_X = [a,b] f_X(x) = \frac{1}{b-a} a\leq x \leq b E[X] = \frac{a+b}{2} VAR[X] = \frac{(b-a)^2}{12} \Phi_X(\omega) = \frac{e^{j\omega b}- e^{j\omega a}}{j\omega(b-a)}

Exponencial

S_X = [0, \infty) f_X(x) = \lambda e ^{-\lambda c} x \geq 0 \text{ , } \lambda > 0 E[X] = \frac{1}{\lambda} VAR[X] = \frac{1}{\lambda ^2} \Phi_X(\omega) = \frac{\lambda}{\lambda - j\omega}

Nota: La variable aleatoria exponencial es la única variable aleatoria contínua con propiedad "sin memoria"

Normal o Gausiana

S_X = (-\infty, +\infty) f_X(x) = \frac{e^{-(x-m)^2 /2 \sigma ^2}}{\sqrt{2 \pi}\sigma}

- ∞ < x < + ∞ , σ >0

E[X] = m VAR[X] = \sigma ^2 \Phi_X(\omega) = e^{jm\omega - \sigma ^2 \omega ^2 /2}Nota: En un amplio rango de condiciones, X puede ser usada para aproximar la suma de un gran número de variables aleatorias independientes

Gamma

S_X = (0, \infty) f_X(x) = \frac{ \lambda (\lambda x)^{\alpha -1} e^{-\lambda x} } {\Gamma(\alpha)} x > 0, \alpha >0, \lambda > 0

donde \Gamma(z) es la función gamma:

\Gamma(z) = \int_{0}^{\infty} x^{z-1} e^{-x} dx , z>0

\Gamma \left(\frac{1}{2} \right) = \sqrt{\pi}

\Gamma (z+1) = z \Gamma(z) , z>0

\Gamma (m+1) = m! , m>0 \text{, y entero}

E[x] = \frac{\alpha}{\lambda}

VAR[X] = \frac{\alpha}{\lambda^2}

\Phi_X(\omega) =\frac{1}{(1-j\omega /\lambda)^{\alpha}}

Casos especiales de Gamma

Erlang m-1

\alpha = m \text{, entero positivo}f_X(x) = \frac{ \lambda e^{-\lambda x }(\lambda x)^{m - 2} } {(m-1)!} x>0

\Phi_X(\omega) = \left( \frac{1}{1-j\omega /\lambda} \right) ^{m}Nota: Una variable aleatoria Erlang m-1 se obtiene al añadir m variables aleatorias exponenciales independientes con parámetro λ

Chi-cuadrado

con k grados de libertad:

\alpha = k/2 \text{, k entero positivo y } \lambda =1/2 f_X(x) = \frac{ x^{(k - 2)/2} e^{-x/2} } {2^{k/2} \Gamma (k/2)} x>0 \Phi_X(\omega) = \left( \frac{1}{1-2j\omega} \right) ^{k/2}Nota: la suma de k variables aleatorias Gausianas, mutuamente independientes, con varianza unitaria, media cuadrada 0, es una variable aleatoria Chi-cuadrada con k grados de libertad.

Lapacian

S_X = (-\infty, +\infty) f_X(x) = \frac{\alpha}{2} e^{-\alpha|x|}

- ∞ < x < + ∞ , α >0

E[x] =0 VAR[X] = \frac{2}{\alpha^2} \Phi_X(\omega) = \frac{\alpha^2}{\omega ^2 + \alpha ^2}Rayleigh

S_X = [0, \infty) f_X(x) = \frac{x}{\alpha^2} e^{-x^2/2\alpha^2} x \geq 0 , \alpha>0 E[X] = \alpha \sqrt{\pi/2} VAR[X] =(2- \pi/2) \alpha^2

Cauchy

S_X = (-\infty, +\infty) f_X(x) = \frac{\alpha / \pi}{x ^2 + \alpha ^2}

- ∞ < x < + ∞ , α >0

NO existe la media o varianza

\Phi_X(\omega) = e^{-\alpha|\omega| }Pareto

S_X = [X_m, +\infty) , X_m>0 f_X(x) = \begin{cases} 0 && x< x_m\\ \alpha \frac{x_m^{\alpha}}{x^{\alpha+1}} && x \geq x_m \end{cases} E[X] =\frac{\alpha x_m}{\alpha - 1}, \alpha >1 VAR[X] =\frac{\alpha x_m^2}{(\alpha - 2)(\alpha-1)^2}, \alpha >2

Nota: La variable aleatoria Pareto es el ejemplo mas destacado de variables aleatorias con colas largas y puede ser vista como una versión contínua de la variable aleatoria discreta Zipf

Beta

f_X(x) = \begin{cases} \frac{\Gamma (\alpha + \beta)}{\Gamma(\alpha) \Gamma(\beta)} x^{\alpha-1} (1-x)^{\beta-1} && ,\alpha>0 \\, && \beta>0 \\ , && 0 < x < 1 \\ 0 && \text{otro caso} \end{cases} E[X] = \frac{\alpha}{\alpha + \beta} VAR[X] = \frac{\alpha\beta}{(\alpha + \beta)^2 (\alpha + \beta + 1)}

Nota: La variable aleatoria Beta es util para modelar una variedad de formas de funciones de densidad de probabilidad en intervalos finitos